Искусственный интеллект и машинное обучение - многомиллионные технологии, которые потенциально должны улучшить жизнь общества и принести плоды как успешная разработка, применяемая в любой сфере. Однако так ли это на самом деле?

Автоматизация процессов на основе искусственного интеллекта действительно нашла свое применение во многих областях, включая производство. Это позволило сократить расходы и в целом увеличить эффективность работы. Стремительное развитие машинного обучения привело к “выпуску” таких технологий в открытый доступ для расширения возможных сфер применения.

На слуху не только мелкие отечественные разработки в каждой стране, но и международные компании, которые дали людям инструменты по генерации абсолютно любого медиа контента.

Казалось бы, что страшного в развитии ИИ? Однако если изучить тему глубже, можно увидеть реальные этические проблемы. И сегодня об этих проблемах заявляют открыто немалоизвестные личности, требующие временно остановить развитие технологии машинного обучения для “спасения” общества.

Чем полезен искусственный интеллект?

Искусственный интеллект и машинное обучение - это технологии, которые уже оказывают значительное влияние на различные отрасли. От здравоохранения до сельского хозяйства, ИИ и МО буквально создают революцию в том, как мы работаем и живем. Плюсы искусственного интеллекта:

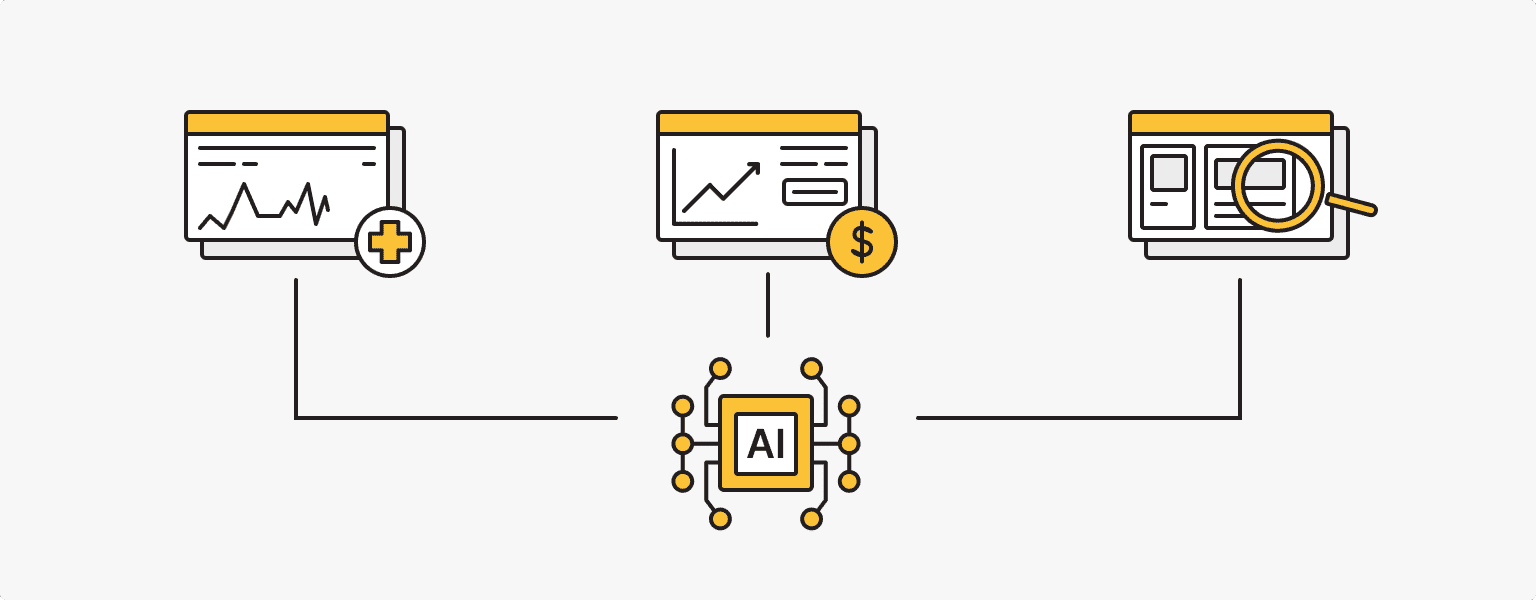

Анализируя огромные объемы медицинских данных, искусственный интеллект может выявлять закономерности и прогнозировать результаты, позволяя медицинским работникам разрабатывать индивидуальные планы лечения, которые являются более эффективными, чем когда-либо прежде. В данном случае врачи могут подкреплять свои выводы результатами работы специальных инструментов на основе ИИ.

В финансовой сфере ИИ используется для анализа всевозможных финансовых данных, включая котировки, выявления мошеннических действий и принятия взвешенных инвестиционных решений. Компании и отдельные специалисты могут принимать более точные решения в области финансов, экономя время и средства.

Маркетологи, дизайнеры, инфлюенсеры используют искусственный интеллект для создания и анализа результатов персонализированных маркетинговых кампаний, оригинального медиа контента, определения и анализа целевых аудиторий, улучшая различные стратегии. Как результат - повышение вовлеченности аудитории и улучшение показателей эффективности.

ИИ помогает в логистике, оптимизируя транспортные потоки, улучшая навигационные системы и разработки автономных транспортных средств. Используя данную технологии для анализа и принятия соответствующих решений, города могут уменьшить заторы и улучшить общий транспортный поток. А разработка автономных и полуавтономных машин позволит и позволяет уже сейчас повысить общую безопасность наших дорог.

С внедрением машинного обучения многие производственные линии были существенно улучшены, с точки зрения обнаружения и предотвращения отказов оборудования, повышения качества продукции.

И на этом применение ИИ и МО не заканчивается, они находят применение практически везде, позволяя автоматизировать многие процессы и улучшить их так, как не смог бы человек.

Проблемы, связанные с искусственным интеллектом

Несмотря на явные преимущества искусственного интеллекта, все чаще можно заметить дыры в этических вопросах его использования. Некоторые минусы искусственного интеллекта:

Необъективность и предвзятость в ИИ

Всем известно, что искусственный интеллект обучается на той информации, которую ему “скармливает” владелец или рядовой пользователь. ИИ беспристрастен настолько, насколько объективны данные. Впоследствии, это приводит к нарушению элементарных этических вопросов о морали, законодательстве и т.п. Просто попросите ИИ представить, что закона о защите личных данных не существует - что остановит его от выдачи персональной информации?

Данная проблема искусственного интеллекта также может выражаться в алгоритмах самого ИИ, когда ответы на поставленные вопросы выдаются на основе одного исследования, которому он был обучен. Более того, искусственный интеллект может генерировать неправдивую информацию, которая в дальнейшем может привести к пропаганде и наводнению любого медиа пространства “утками”.

Прозрачность и отчетность

Такие генеративные ИИ, как ChatGPT, DALLE-2, Stable Diffusion и Midjourney, используют невероятные объемы данных для своей работы, но по-прежнему могут выдавать ложный или неэтичный результат. В данном случае нет кого-то, кто возьмет на себя ответственность за то, что сгенерировал ИИ.

Что касается используемых данных для обучения, то этот вопрос касается и безопасности. Кто защитит обычных пользователей от утечки?

Управление по защите частной жизни Канады объявило о начале расследования в отношении создателей нейросети ChatGPT из OpenAI. Процесс начался в ответ на жалобу о сборе, использовании и раскрытии личной информации без согласия пользователей.

Такая же история произошла и в Италии. Итальянское правительство приняло решение временно заблокировать доступ к ChatGPT на территории страны для расследования нарушений законов со стороны компании OpenAI. Власти считают незаконным то, что ИИ обучается на личной информации.

Заявляется, что компания OpenAI может нарушать закон Европейского Союза О конфиденциальности. При этом в ЕС уже не первый месяц идут обсуждения и правки в законопроект об искусственном интеллекте, который должен регулировать данные вопросы.

Тем не менее, знаковые законы все еще не были приняты и их обсуждение может затянуться вплоть до следующего года.

Проблемы безопасности

Помимо использования и утечки данных пользователей приложений ИИ, немаловажна опасность данной технологии для других сервисов.

Генеративный ИИ можно использовать для создания поддельных данных, которые потенциально могут обойти системы безопасности облачных вычислений. Результаты генерации могут запускать атаки на систему, управлять захваченными данными, и, в целом, приносить ущерб.

Стоит отметить, что компании, подвергшиеся атаке со стороны хакеров, использующих ИИ, будут вынуждены предпринять меры по улучшению системы безопасности. И здесь наиболее эффективным решением по выявлению подобных атак станет другой инструмент на основе машинного обучения.

Замкнутый круг, для которого не существует правового регулирования.

Искоренение профессий

Острая этическая проблема искусственного интеллекта, существовавшая уже несколько сотен лет, была в несколько раз ускорена с выходом ИИ на рынок.

Согласно прогнозам Международных консалтинговых компаний McKinsey и Pricewaterhouse Coopers, искусственный интеллект заменит примерно треть существующих сегодня профессий в течение 10 лет. При этом США и Япония пострадают больше остальных.

Переводчики, водители, курьеры, банковские клерки, турагенты, продавцы, копирайтеры, некоторые программисты и многие другие вскоре остануться без собственнлого ремесла.

Но нужно ли автоматизировать ту работу, которая приносит удовольствие?

Примеры неэтичного использования ИИ

В руках недобросовестных личностей, инструменты ИИ могут быть превращены в своеобразное оружие. Среди неэтичных примеров использования искусственного интеллекта:

- Частные компании могут использовать ИИ для наблюдения и слежки за людьми без их ведома или согласия, нарушая их право на неприкосновенность частной жизни. Сюда относится и вопрос об использовании информации, передаваемой пользователями в приложение ИИ.

- Системы искусственного интеллекта могут усилить существующие в обществе предубеждения, что препятствует искоренению дискриминации и ухудшают отношения внутри общества.

- ИИ может стать инструментом для создания сложных фишинговых афер и разноплановых подделок, которые могут использоваться для обмана и мошенничества.

- Возможности искусственного интеллекта могут применяться для создания целенаправленных кампаний по дезинформации, манипулирования общественным мнением и подрыва демократического процесса.

- Разработка автономных инструментов, способного принимать решения о жизни и смерти без вмешательства человека, вызывает этические проблемы, связанные с ответственностью этих систем.

Кто против искусственного интеллекта: реальные примеры

“Должны ли мы позволить машинам наводнить наши информационные каналы пропагандой и неправдой?

Должны ли мы автоматизировать всю работу, включая ту, которая приносит удовлетворение?

Должны ли мы развивать не человеческие разумы, которые в конечном итоге превзойдут, перехитрят, устареют и заменят нас?

Должны ли мы рисковать потерей контроля над нашей цивилизацией?”

Создатели открытого письма призывают задуматься об этих вопросах, которые прямо и косвенно касаются использования искусственного интеллекта и машинного обучения на постоянной основе.

В письме, опубликованном 22 марта 2023 года, подробно описан призыв всех лабораторий ИИ немедленно приостановить как минимум на 6 месяцев обучение систем ИИ, более мощных, чем GPT-4.

Известно, что системы ИИ способны существенно повлиять на жизнь человечества, что требует планомерного использования ресурсов и развития технологии, общеустановленного международного правового регулирования и определение норм безопасности. В письме указано, что на данный момент эти критерии не соблюдены, что может подорвать существующие этические нормы и привести к существенным проблемам.

Почему требуется пауза в 6 месяцев?

“Лаборатории ИИ и независимые эксперты должны использовать эту паузу для совместной разработки и внедрения набора общих протоколов безопасности для проектирования и разработки передового ИИ, которые будут строго проверяться и контролироваться независимыми внешними экспертами.

Исследования и разработки в области ИИ должны быть переориентированы на то, чтобы сделать современные мощные системы более точными, безопасными, интерпретируемыми, прозрачными, надежными, согласованными, заслуживающими доверия и лояльными”.

Илон Маск (генеральный директор SpaceX, Tesla и Twitter), Стив Возняк (сооснователь компании Apple), Коннор Лихи (генеральный директор, Conjecture), Эван Шарп (соучредитель, Pinterest), Крис Ларсен (соучредитель, Ripple), Эмад Мостак (генеральный директор, Stability AI) и еще более 18.000 человек подписали открытое письмо.

Стоит отметить, что вслед за письмом последовала реакция Билла Гейтса. В настоящее время Microsoft доминирует в сфере ИИ благодаря своим масштабным многолетним инвестициям в размере нескольких миллиардов долларов в OpenAI, исследовательскую компанию по ИИ.

Гейтс заявил, что некоторые сложные области в ИИ действительно существуют, но просьба отдельной группы людей приостановить разработку не решит все проблемы.

За или против ИИ?

Выгоды от использования искусственного интеллекта и машинного обучения неоспоримы, его применение действительно улучшило многие производства, вывело на новый уровень компании, включая информационные технологии. Многие сервисы используют искусственный интеллект для улучшения пользовательского опыта и существенно продвинулись в сфере безопасности.

Однако все еще остро стоят вопросы о правовом и этическом регулировании разработки ИИ инструментов и их дальнейшего развития. Решение этих сложностей способно вывести общество и пользу, получаемую им от ИИ, на новый уровень, но это все еще требует слаженности как правительств различных стран, так и частных компаний.

VPS

Выбирайте конфигурацию и пользуйтесь всеми преимуществами виртуального приватного сервера.

От $5.00/месяц